SVX日記

2011-05-20(Fri) チープに歌うLinux「妖音リナ」

先日、思わせぶりなことを書いたが、なんでいきなり昔作ったDTMアプリを引っ張り出してきたかというと、Linux上でOSSだけを組み合わせて「歌わせてみた」いから、そのための前哨戦だったワケだったりする。

なんだかんだいって、以前に作曲のマネゴトをしてたワケだし、いまこの瞬間も「初音ミク」には手を出す寸前なのだ。ただ、Windows上でGUIでってのが、オイラにとってはかなり敷居が高い。Linux用のボーカロイドが欲しい。が、ない。んじゃ、作る。

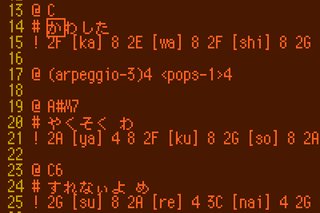

echo 'ah' | text2wave -o ah.wav; play ah.wavecho "ah" | text2wave | sox -t wav - ah_200.wav pitch 200sox -M words/word_ka_900.wav "| sox words/word_wa_800.wav -p pad 0.18750" "| sox words/word_shi_900.wav -p pad 0.37500" midi/connect_vocal.wav remix -i; play midi/connect_vocal.wavそういえば、以前から「初音ミク」はボーカルだけのソフトなので、他のDTMで作った伴奏と、どうやってミキシングするのかが疑問だった。そもそも、MIDIファイルって、サウンドカードを経由せずにwavファイルかなんかに変換できるものなのか? できないのなら、PCのラインジャックとマイクジャックをつないで録音しなければならない? ……と思ったら、昨日のtimidityでアッサリできるようだ。

timidity -OwS midi/connect.mid -o midi/connect.wav

「チューリップの歌」<mp3を再生する>

「イッペイのテーマ」<mp3を再生する>

「コネクト」<mp3を再生する>

「かえるの歌」<mp3を再生する>

「かえるの歌x2」<mp3を再生する>

「かえるの歌x3」<mp3を再生する>

[ツッコミを入れる]